Beste KI für HNO-Ärzte

Künstliche Intelligenz krempelt die Hals-Nasen-Ohren-Heilkunde schon heute gewaltig um. Wer meint, es handle sich nur um Zukunftsmusik, irrt: Von der überraschend akkuraten Auswertung von CT- und MRT-Aufnahmen bis hin zur blitzschnellen Analyse von Stimmproben, KI-Systeme greifen Ärzten unter die Arme.

Sie sorgen nicht nur für mehr Tempo in der Diagnostik, sondern machen Therapien spürbar individueller und helfen, komplizierte Krankheitsbilder besser zu erfassen. Mittlerweile sind diese Technologien fester Bestandteil des Klinikalltags geworden, auch wenn viele ihren wertvollen Beitrag teilweise noch unterschätzen.

Wie KI die diagnostik im HNO-bereich bereits unterstützt

Schon heute beeinflusst künstliche Intelligenz die Diagnostik im HNO-Bereich, allerdings nicht immer so gradlinig, wie man vermuten könnte. Digitale Bildgebung und die Digitalisierung klassischer Funktionstests liefern einerseits die Datenbasis, die Algorithmen überhaupt brauchen. Doch genauso wichtig: Es ist die tägliche Erfahrung in den Praxen, die viele Daten so einzigartig macht.

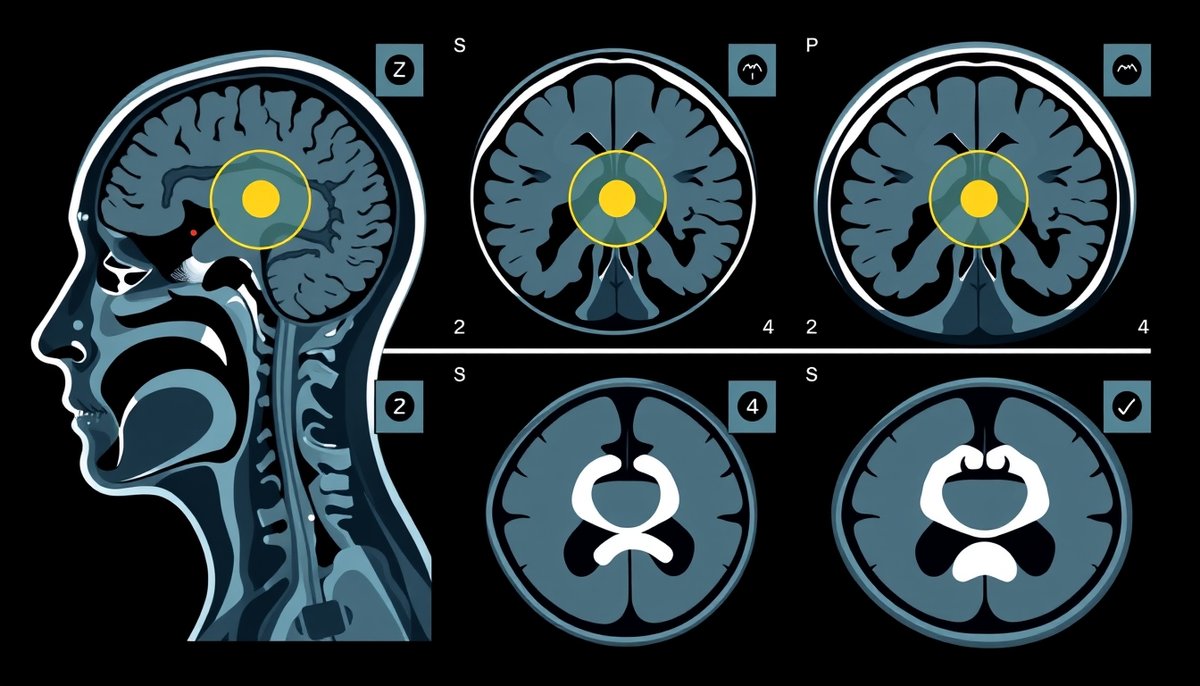

Digitale bildgebung als datenquelle

Kaum vorstellbar, dass Bildgebung vor einigen Jahren noch analog war. Verfahren wie Computertomographie (CT), Magnetresonanztomographie (MRT) und Sonographie (Ultraschall) liefern heute gestochen scharfe Aufnahmen von Strukturen wie dem Kehlkopf oder den Nasennebenhöhlen. Diese digitalen Bilder werden mit zunehmender Routine benutzt, um KI-Modelle zu trainieren. Wenn es darum geht, winzige Veränderungen etwa bei Tumoren zu entdecken, erkennt ein passend geschultes System Details, die im Stress des Klinikalltags manchmal durchrutschen würden.

Unterschätzt man dabei digitale Endoskopiesysteme, übersieht man entscheidende Fortschritte. Flexible oder starre Endoskope erfassen zum Beispiel laryngeale Strukturen sehr detailliert. Die daraus gewonnenen Videodaten sind wie ein Goldschatz: Sie helfen nicht nur bei der Dokumentation im Alltag, sondern bieten Forschern eine solide Fläche, KI-Lösungen für die Tumordiagnostik zu entwickeln und später zu testen.

Digitalisierte funktionsdiagnostik

Modernes Arbeiten in Praxen heißt längst: Auch traditionelle Funktionstests wandern mehr und mehr in digitale Sphären.

- Audiometrie: Neuere Audiometer speichern Messungen fast wie von selbst im System und schicken sie gleich in die elektronische Patientenakte (EPA). Otoakustische Emissionen liefern dabei verständliche Kurven, die aus Sicht der KI eine richtig praktische Datengrundlage bieten.

- Gleichgewichtsprüfung: Bei der Videonystagmographie (VNG) filmen Infrarotkameras Bewegungen der Augen. Die Auswertung übernimmt dann immer öfter der Computer und hilft Ärzten, komplexe Störungen des Gleichgewichts rascher zu erkennen.

- Rhinomanometrie: Hier messen digitale Sensoren feinfühlig den Atemstrom durch die Nase. Diese Werte landen nicht nur in Verlaufsstatistiken, sondern dienen direkt für wissenschaftliche Auswertungen.

Wer sich einmal ansieht, wie diese Daten in elektronischen Systemen archiviert werden, merkt schnell: Die Grundlage für Telemedizin und KI-Modelle, die bisher verborgene Muster erkennen, ist jetzt bereits gelegt, und bietet für die Zukunft spannende Möglichkeiten.

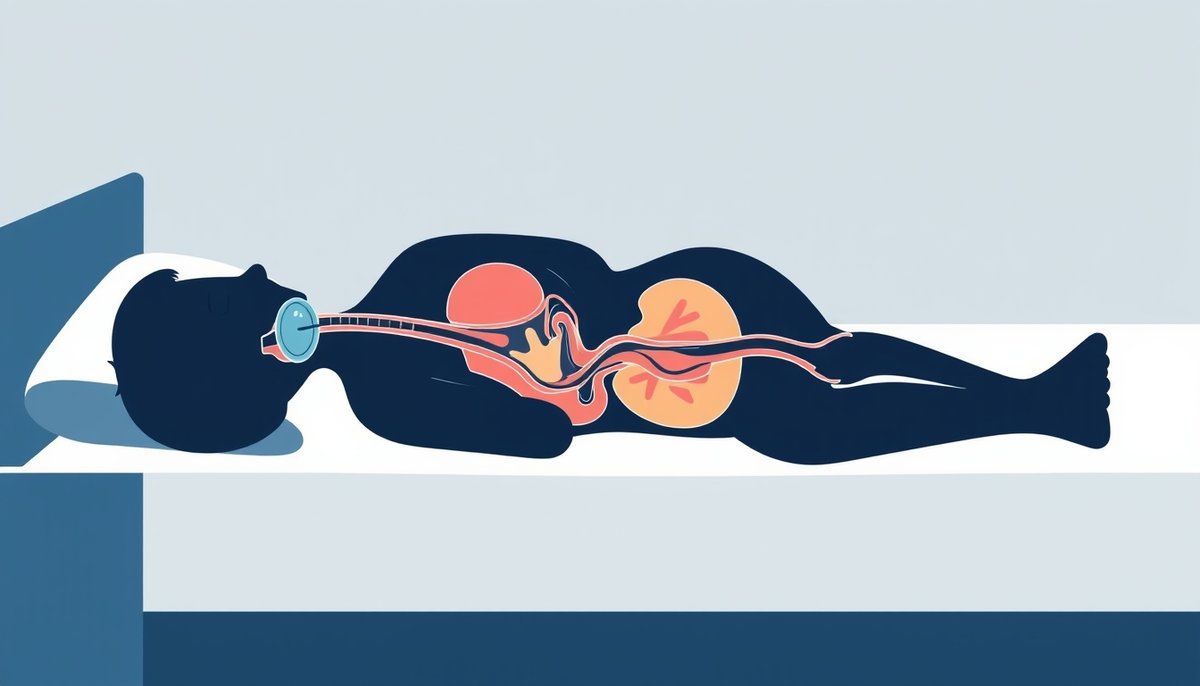

Wie KI die diagnose von schlafapnoe revolutioniert

Wer hätte gedacht, dass die oft unterschätzte Schlafapnoe davon besonders profitieren würde? Gerade die Behandlung der obstruktiven Schlafapnoe (OSA) rückt dank digitaler Entwicklungen viel stärker in den Mittelpunkt. Insbesondere die Auswertung von Schlafendoskopien und Ultraschallbildern verändert sowohl die Diagnostik als auch die Therapieplanung für betroffene Patienten. Man spürt förmlich, wie neue Optimierungsmöglichkeiten greifbar werden.

Automatisierte analyse von video- und bilddaten

Es sind vor allem Algorithmen wie Convolutional Neural Networks (CNNs), die aus Videoaufnahmen von Schlafendoskopien überraschend präzise Muster filtern können. Das sorgt nicht nur für standardisierte, sondern auch deutlich objektivere Befunde, als sie rein subjektiv möglich wären.

Die wichtigsten Felder, in denen KI hier punktet:

- Segmentierung anatomischer Strukturen: Echte Erleichterung: Die KI findet und grenzt etwa Gaumensegel oder Epiglottis im Video automatisch ab. Die genaue Stelle der Verengung lässt sich dadurch wesentlich leichter bestimmen, wie mit einer Lupe für den digitalen Hals.

- Klassifikation von Kollapsmustern: Ohne den Arzt als alleinigen Prüfer zu belasten, stuft die KI zuverlässig den Typ und die Stärke des Atemwegskollapses ein. Objektive Daten unterstützen die oft subjektiven Erfahrungen.

- Quantifizierung des Kollapsgrades: Statt geschätzter Zahlen liefert der Computer konkrete Werte zur Engstelle. Der Arzt kann so Therapien besser planen und Veränderungen nachvollziehen.

Bessere therapieplanung und prognosen

Wenn man unterschiedliche Daten, zum Beispiel Endoskopievideos, Ultraschallaufnahmen und Polysomnographiewerte, miteinander kombiniert, kann die KI erstaunlich genaue Prognosemodelle basteln. Sie unterstützt Ärzte dabei, die richtige Therapie zu wählen, sei es CPAP, eine Schiene oder eine OP, und gibt Hinweise darauf, wie wahrscheinlich der Erfolg ist. Die vergleichbaren Befunde erleichtern zudem eine konsequente Verlaufsbeobachtung.

Natürlich gibt es auch Haken: Während die Auswertung von Polysomnographie-Daten mit KI schon recht weit ist, steht der Einsatz bei Schlafendoskopien und Ultraschall eher erst am Anfang. Die größte Hürde bleibt der Aufbau ausreichend großer, qualitativ guter und sorgfältig markierter Datensammlungen, damit die Systeme wirklich verlässlich lernen können.

Welche neuen möglichkeiten bietet KI in der kopf-hals-onkologie?

In Sachen Kopf-Hals-Tumoren ist KI nicht einfach ein Werkzeug, sondern wirkt oft fast wie ein kreativer Partner: Sie bringt die personalisierte Medizin entscheidend nach vorn und sorgt dafür, dass Therapien passgenauer und genauer geplant werden. Dabei begleitet sie Ärzte auf dem gesamten Weg von der Diagnose, über die Behandlung bis zur Rehabilitation.

Präzisere diagnostik und therapieplanung

Ein erheblicher Fortschritt: Metastasendiagnostik mit Radiomics-Analyse. Spezielle Algorithmen kitzeln unsichtbare Merkmale aus CT- und MRT-Bildern heraus, die sonst niemand erkennt. Dadurch können auch winzige Lymphknotenmetastasen entdeckt werden, was für die Behandlungsstrategie oft den sprichwörtlichen Unterschied macht. Auch die Stadieneinteilung wird exakter, am Ende stehen oft individuellere Therapien.

Daneben gibt es weitere Anwendungen, die nicht minder relevant sind:

- Personalisierte Therapieentscheidungen: Unsere Datenberge, aus Akten, Labor und Genanalysen, werden von unternehmungslustigen Algorithmen durchforstet. Sie erspüren Muster und verbessern die Einschätzung von Rückfallrisiko und Erfolgsaussichten.

- Echtzeit-Analyse bei Endoskopien: Während der Untersuchung entgeht dem KI-System meist keine Schleimhautveränderung. Die sofortige Analyse steigert die Sicherheit und Präzision.

- Automatisierte Auswertung von Biopsien: Die KI unterstützt Pathologen gezielt bei der Gewebeauswertung. Das spart Zeit und steigert die Sicherheit der Diagnose, gerade bei schwierigen Fällen.

Unterstützung bei der rehabilitation

Rehabilitation nach einer Behandlung ist mehr als Routine. Mit KI-gestützten Lösungen lassen sich sehr individuelle Trainingspläne für Sprechen, Schlucken oder Kieferbewegungen erstellen. Mobiles Feedback über Apps oder Wearables motiviert und erkennt erste Komplikationen, fast wie ein wachsamer Begleiter im Alltag. Virtual-Reality-Anwendungen machen die Übungen teilweise so spannend, dass Patienten langfristig am Ball bleiben, was die Erfolgschancen steigert.

Welche KI-tools gibt es bereits für audiologie und stimmanalyse?

Auch wenn vieles noch in der Entwicklung steckt, besonders in Deutschland gibt es schon ganz handfeste Anwendungen, und zwar in der audiologischen Diagnostik und der Stimmanalyse. Sie wurden geschaffen, um die Auswertung einfacher zu machen und Diagnosen wirklich zu verbessern.

Führende anbieter und produkte

Manche Namen hört man in der Branche immer wieder. Ein wesentliches Beispiel: Die audEERING GmbH. Dieses Unternehmen ist besonders aktiv und entwickelt Lösungen auf Basis lernfähiger Verfahren, die Sprach- und Stimmproben genau analysieren und daraus Rückschlüsse auf die Gesundheit ziehen.

| Produkt | Beschreibung | Anwendungsbereich |

|---|---|---|

| devAIce® | Ein Software Development Kit (SDK) samt Web-API zur Analyse von Stimm- und Hörparametern. | Integration in digitale Tools, klinische Studien und Forschungsprojekte. |

| AI SoundLab | Plattform für die anonyme Auswertung von Sprach- und Audiodaten. | Umfassende Studien, Analyse von Stimmbiomarkern etwa zur Früherkennung von Erkrankungen. |

| devAIce® XR | Zusatzmodul für Anwendungen in Virtual- oder Augmented Reality. | Fördert Telemedizin, Fern-Diagnostik und Forschung in virtuellen Umgebungen. |

#### Was können diese systeme bereits leisten?

Die Fortschritte sind beeindruckend. So ermöglichen die Lösungen von audEERING eine erstaunlich frühe Erkennung etwa von Multipler Sklerose (67 % Trefferquote) oder Depressionen (76 % Genauigkeit) allein auf Basis einer computergestützten Stimmanalyse. Mit jedem zusätzlichen Datensatz werden die Anwendungen sicherer und präziser, da sie stetig hinzulernen. Datenschutz und die Einhaltung der DSGVO liegen dem Unternehmen besonders am Herzen, was für Patienten sehr beruhigend ist.

Forschung und ausblick

Neben Firmen sind forschungsstarke Institute, zum Beispiel das Fraunhofer IDMT, fleißig dabei, neue KI-Lösungen für die Audiologie zu entwickeln. Bis zur breiten Nutzung im Praxisalltag ist es zwar noch ein Stück Weg, aber das Potenzial ist riesig. Wichtig bleiben weitere Studien, Zulassungen und vor allem die unkomplizierte Integration in gewohnte Abläufe, damit Ärzte und Patienten gleichermaßen profitieren.

Was sind die rechtlichen und ethischen spielregeln für KI in der HNO?

Wer sich fragt, wie KI in der Medizin reguliert wird, merkt rasch: Es gibt genaue Regeln, und zwar europaweit. Besonders für HNO-Ärzte, die KI nutzen möchten oder an Entwicklungen beteiligt sind, sind die Medizinprodukteverordnung und die DSGVO zu zentralen Leitplanken geworden.

Medizinprodukteverordnung (MDR)

If eine KI-Software bei der Diagnose oder Behandlung verwendet wird, gilt sie ganz klar als Medizinprodukt, sie muss also den Vorschriften der europäischen Medizinprodukteverordnung (MDR) entsprechen. Das sorgt dafür, dass die Anwendung sicher bleibt und gut funktioniert.

- Risikoklassen: Die Einstufung der Systeme richtet sich nach ihrem Einfluss auf Patienten. Produkte zur Therapieplanung landen dabei in einer höheren Risikostufe als einfache Dokumentationshilfen.

- Technische Dokumentation: Firmen müssen ausführlich zeigen, wie ihr System funktioniert, wie es geschützt ist und wie sie die Wirksamkeit nachweisen.

- Menschliche Kontrolle: Die Entscheidung trägt letzten Endes immer der betreuende Arzt. Die KI dient lediglich als hilfreiches Werkzeug, das nie den Menschen ersetzt.

Datenschutz (DSGVO)

KI-Modelle sind angewiesen auf sensible Gesundheitsdaten, gerade deshalb ist der Schutz dieser Informationen so grundlegend. Die Datenschutz-Grundverordnung (DSGVO) sowie das Bundesdatenschutzgesetz (BDSG) geben dazu klare Regeln vor.

- Verarbeitung von Gesundheitsdaten: Für die Verwendung dieser sensiblen Daten braucht es eine ausdrückliche Zustimmung der Patienten. Ohne geht es eigentlich nicht.

- Recht auf Erklärung: Kein Patient muss eine Entscheidung akzeptieren, die rein aus einer automatisierten Analyse stammt. Die Ergebnisse von KI müssen überprüfbar und verständlich bleiben.

- Anonymisierung: Für die Forschung sollten Patienteninformationen so gut es geht anonymisiert oder pseudonymisiert werden, damit die Privatsphäre wirklich gewahrt bleibt.

Daran zu halten, festigt das Vertrauen der Menschen in diese Technik und sorgt dafür, dass Ärzte und Patienten verantwortungsvoll damit umgehen können.

Welche hürden stehen einer breiten anwendung noch im weg?

All die beschriebenen Möglichkeiten klingen vielversprechend, und trotzdem gibt es Stolpersteine, die die Einführung von KI in den deutschen HNO-Alltag stark bremsen. Technische, organisatorische und finanzielle Hindernisse sind nicht zu unterschätzen.

Zu den größten technischen Baustellen gehört die mangelnde Verfügbarkeit von großen, möglichst vollständigen und einheitlichen Datensätzen. Wenn Ärzte Tumorstellen etwa auf Endoskopieaufnahmen einzeln markieren müssen, kostet das enorm viel Zeit und Geld. Die Vielfalt an IT-Systemen, inklusive unterschiedlicher Dateiformate für Bilder, Audiogramme und Text, macht die Datensammlung aus verschiedenen Kliniken ziemlich mühsam.

Kommt dann noch die deutsche Gründlichkeit beim Datenschutz dazu, wird die Zusammenarbeit nicht einfacher. Forschungsprojekte leiden manchmal darunter, dass sich Daten nicht so einfach teilen oder verknüpfen lassen. Hinzu kommt: Auf dem Arbeitsmarkt sind Expertinnen und Experten gefragt, die Medizin und Datenanalyse gleichermaßen beherrschen, sie sind aber noch Mangelware.

Finanziell drückt das Thema oft ebenso. Für kleinere Häuser wird die Investition in neue IT, teure Entwicklung und das nötige Personal schnell untragbar. Da viele KI-Anwendungen ihren Nutzen bislang kaum in groß angelegten Studien belegen können, ist oft Zurückhaltung angesagt.

Um diese Hürden aus dem Weg zu räumen, braucht es einen langen Atem und viel Kooperation. Kliniken, Wissenschaft, Politik und Industrie müssen gemeinsam an einem Strang ziehen, wie bei der Medizininformatik-Initiative (MII) gezeigt wird. Ziel ist letztlich ein bundesweiter Datenpool. Sollte das gelingen, kann KI die HNO-Heilkunde von der Früherkennung bis zur OP-Planung komplett verändern. Das Vertrauen von Ärzten und Patienten bleibt für den Durchbruch jedoch entscheidend. KI wird ihren Nutzen erst voll zeigen, wenn Menschen die Technik als echte Unterstützung wahrnehmen, und das ist sicher noch ein Stück Arbeit.